AI bisa deteksi deepfake hanya belajar dari foto

Dalam gambar yang dimanimulasi, mereka menyorot piksel di sepanjang batas objek yang telah ditambahkan secara digital ke gambar.

Teknik deepfake memiliki potensi yang sangat besar. Deepfake sendiri bisa diartikan sebagai foto maupun video yang telah dimanipulasi sehingga dapat menampilkan tampilan wajah seseorang dengan sangat meyakinkan. Agar dapat menanggulangi masalah tersebut, ilmuwan berhasil menciptakan deep learning demi mendeteksi apakah ada media yang telah dimanipulasi.

Dipimpin oleh profesor Amit K. Roy-Chowdhury, sebuah tim di University of California, Riverside memulai dengan serangkaian besar data foto (dataset) yang telah dimanipulasi dan yang tidak dimanipulasi. Para peneliti sudah tahu mana yang sudah terkena dampak, dan memberinya label.

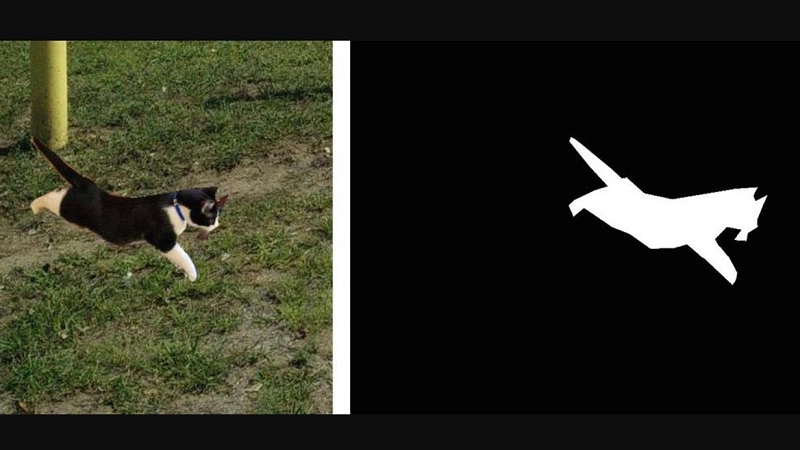

Dalam gambar yang dimanipulasi, mereka menyoroti piksel di sepanjang batas objek yang telah ditambahkan secara digital ke gambar. Pada sebuah foto palsu, terlihat batas yang cenderung lebih halus atau berbeda dari objek yang sebenarnya ada di dalam foto. Dilansir dari New Atlas (19/7), meskipun perbedaan tersebut tidak dapat terdeteksi oleh mata manusia, pemeriksaan piksel demi piksel yang dilakukan oleh komputer dapat mendeteksinya.

Dataset berlabel kemudian dimasukkan ke dalam deep neural network, yang merupakan satu set algoritma yang dirancang untuk mengenali pola dalam data mentah. Dengan menggunakan gambar, jaringan itu belajar mengidentifikasi batasan tanda dari gambar yang ditambahkan secara digital. Ketika kemudian diperlihatkan foto-foto dari luar dataset yang belum pernah dilihat sebelumnya, ia bisa mengenali hampir keseluruhannya.

Meskipun sistem saat ini hanya berfungsi pada foto, tim terus berupaya menerapkanya pada video, di mana kemungkinan besar hanya akan menganalisis setiap frame. Dengan demikian, kemungkinan bisa digunakan untuk mendeteksi gambar mencurigakan yang kemudian dianalisis lebih dalam.